Expérimentez, optimisez, boostez votre croissance

Leader dans l’A/B Testing, créez rapidement et facilement de nouvelles expériences pour augmenter vos taux de conversion en un temps record.

De CTR pour Lush

+250%

De revenupour Lancome

+15%

De taux de succès des A/B tests

x3

Pourquoi choisir AB Tasty comme partenaire

Accompagnement global via un programme CRO bien défini

Outil d’A/B testing simple : testez et déployez rapidement vos idées

Synchronisation fluide avec vos outils & votre stratégie digitale actuelle

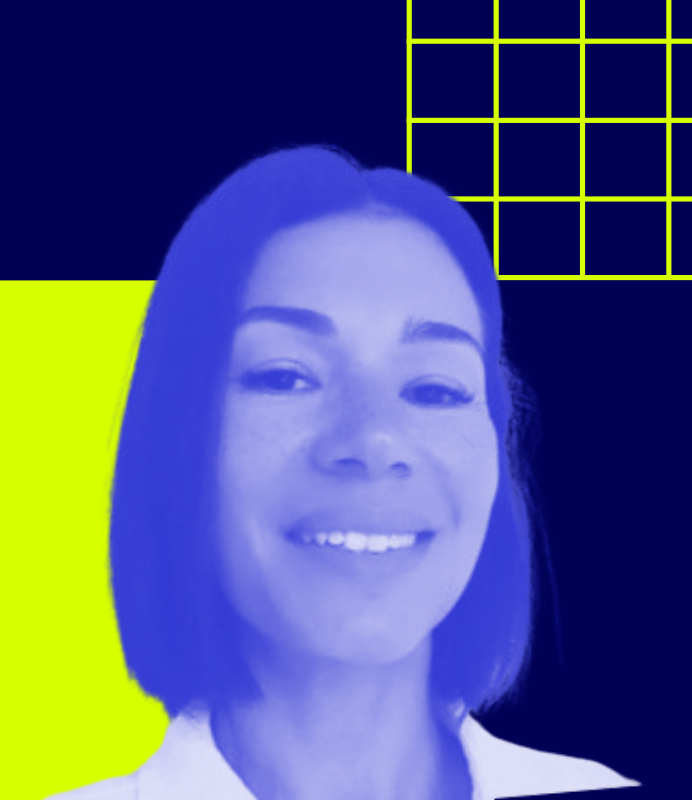

Expérimentation web

Votre progrès, notre priorité

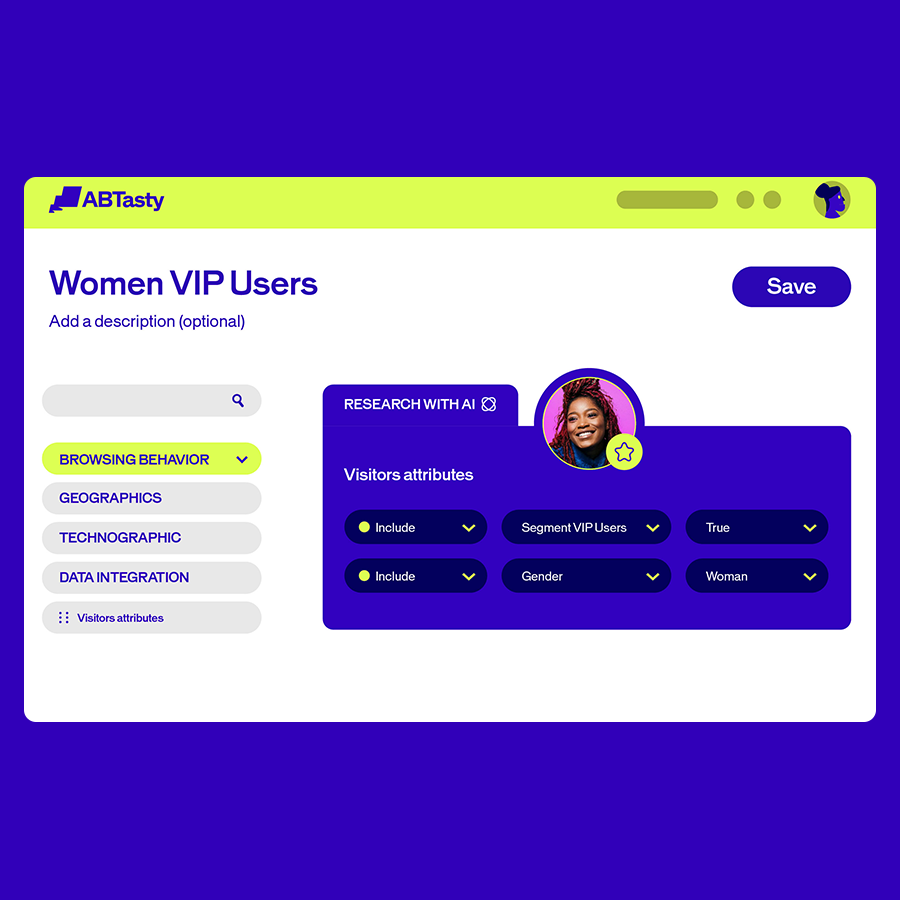

Testez & Optimisez

Avec AB Tasty, identifiez la variation la plus performante en un clin d’oeil !

- Challengez simplement votre parcours utilisateur puis, progressivement de façon plus élaborée.

- Mettez toutes les chances de votre côté avec des tests A/B, splits, multivariés ou multipages.

- Testez votre parcours utilisateur global et vérifiez l’efficacité des changements effectués sur votre site, application, mobile…

Derrière la Technologie

Prenez vos décisions avec conviction et l’assurance d’une meilleure conversion

Your paragraph text here

Statistiques bayésiennes

Les bonnes décisions sont à portée de main. Utilisez la probabilité de gain et la valeur médiane pour évaluer au mieux l’impact de vos expériences. Prenez des décisions plus rapidement, évaluez le retour sur investissement et réduisez les faux positifs.

Maîtrisez vos échecs grâce aux tests séquentiels

Il n’y a pas de mal à échouer en toute sécurité ! Détectez rapidement les variations moins performantes en fonction de la cible.

Premier créateur d’expérience

Depuis 13 ans, des milliers de marques mettent en place leurs meilleures idées via notre expertise pour une expérience client optimale.

Sucess stories

Fonctionnalités

Tout ce dont vous avez besoin pour amener vos visiteurs de A à B

Identifier l’impact business de vos expérimentations est désormais un jeu d’enfant

Grâce à des analyses poussées, observez l’impact positif des tests sur votre croissance. Choisissez parmi un ensemble de KPIs et analysez les résultats en filtrant votre audience.

Établissez simplement des analyses de résultats avec des bénéfices attribués par campagne et période.

Grâce à l’IA et notre module EmotionsAI, vous minimisez les tests sans intérêts.

Une intégration facile pour des résultats rapides

Intégration facile

Pour utiliser AB Tasty sur votre site web, vous n’avez qu’à installer notre tag. C’est tout. À implémenter directement sur votre site ou via un gestionnaire de tags.

Votre progrès est notre progrès

Nous vous assistons à chaque étape de votre parcours, où que vous soyez dans le monde.

Croissance, croissance, croissance

Développez la maturité de votre stratégie CRO en apprenant des autres sur les défis et les solutions de votre secteur lors d’événements clients dédiés ou avec votre CSM.

Des possibilités infinies

Nous offrons un support de développement front-end pour faire de vos idées complexes des expériences exceptionnelles.

Bien plus qu’une techno de qualité

Nous sommes des humains sympas, à l’écoute et présents, qui ne se contentent pas de vous aider à utiliser AB Tasty mais vous invitent plutôt à exploiter tout son potentiel en vous conseillant dans vos actions pour optimiser votre stratégie d’expérimentation et rechercher votre plus grande satisfaction.

Optimisé pour la performance

Laissez-nous gérer les pics lors des périodes les plus intenses pour vous concentrer sur vos conversions.

Nous gérons plus de 70 milliards d’événements par jour. Nous avons des temps de performances de haut niveau avec un temps de chargement inférieur à 100ms. AB Tasty vous donne également le contrôle sur les performances avec notre Centre de Performance pour optimiser le temps de chargement et la performance de votre tag.

Pourquoi choisir AB Tasty comme plateforme d’optimisation de l’expérience ?

Leaders du marché

En tant que Forrester Wave leader et fort de notre note de 4,8/5 sur G2 Crowd, plus de 1000 marques nous font confiance pour aider leurs équipes marketing et produit à optimiser et à innover au quotidien.

Accompagnement

Apprécié pour son support réactif et local, vous bénéficiez en tant que client AB Tasty de l’expertise de nos experts en stratégie digitale pour vous aider à évoluer plus rapidement.

Confidentialité et sécurité

La protection des données personnelles est essentielle pour AB Tasty. Nous sommes conformes au GDPR et au CCPA, et nous proposons des options cookieless.

Orientés performance

Nous comprenons que la performance d’un site web est vitale. AB Tasty propose de nombreuses fonctionnalités pour en optimiser les performances ainsi qu’une solution d’expérimentation et d’innovation sans effet flicker.

Boostez votre

croissance avec

AB Tasty

Planifiez une démonstration personnalisée