Una sola plataforma para todo tu progreso

Probar nuevas funciones, acelerar resultados, mejorar cada experiencia. Todo empieza con una mentalidad de optimización. Todo empieza con probar y luego hacerlo mejor.

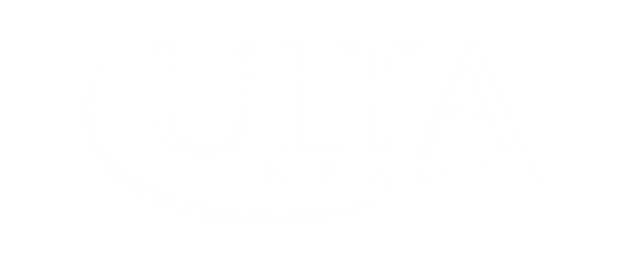

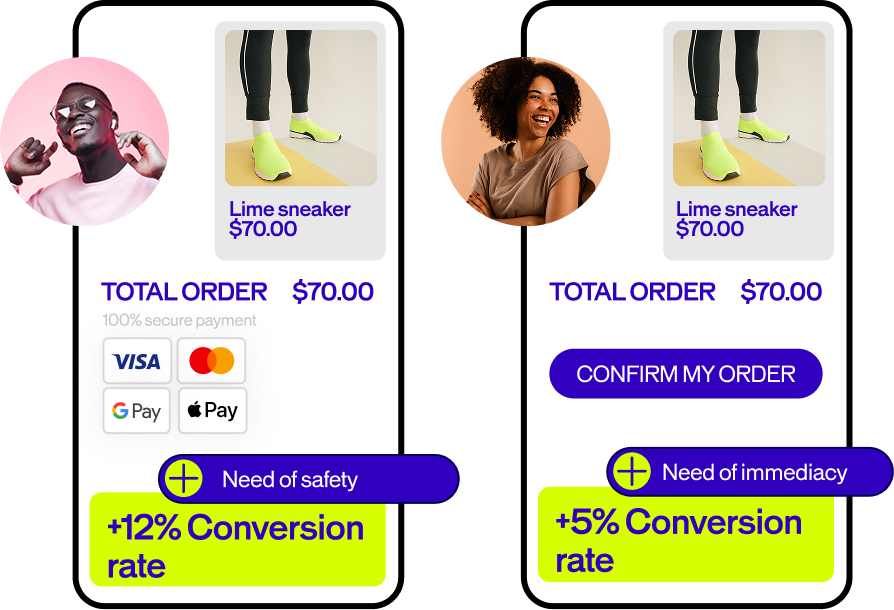

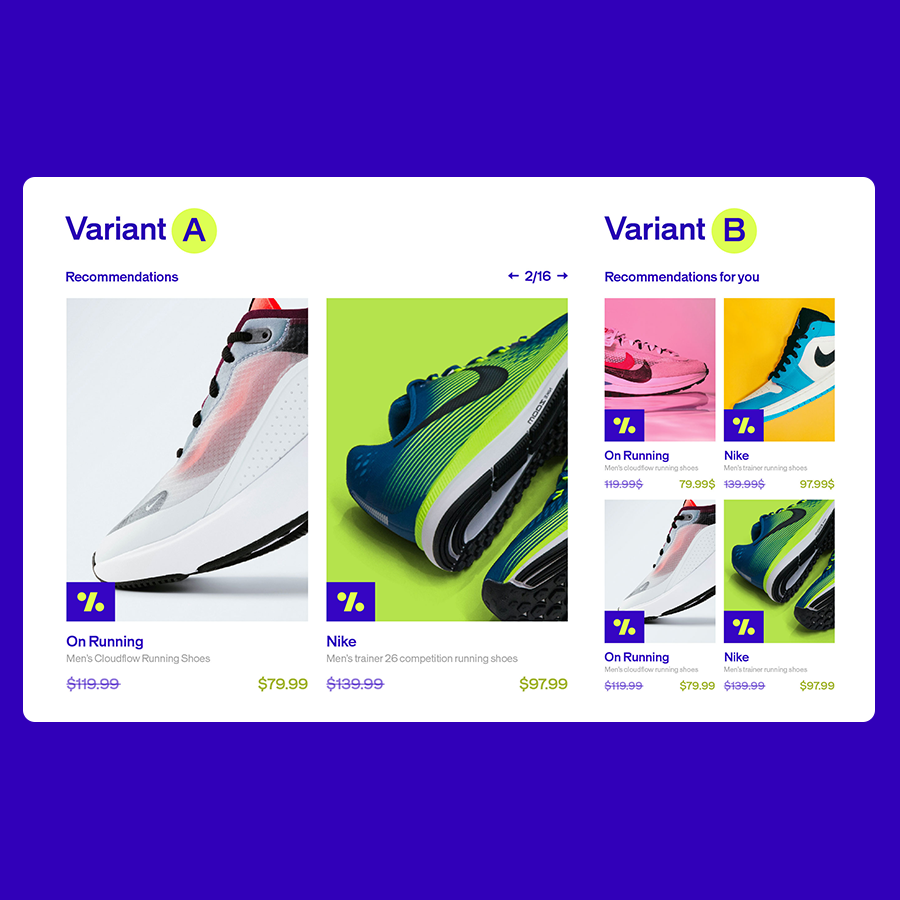

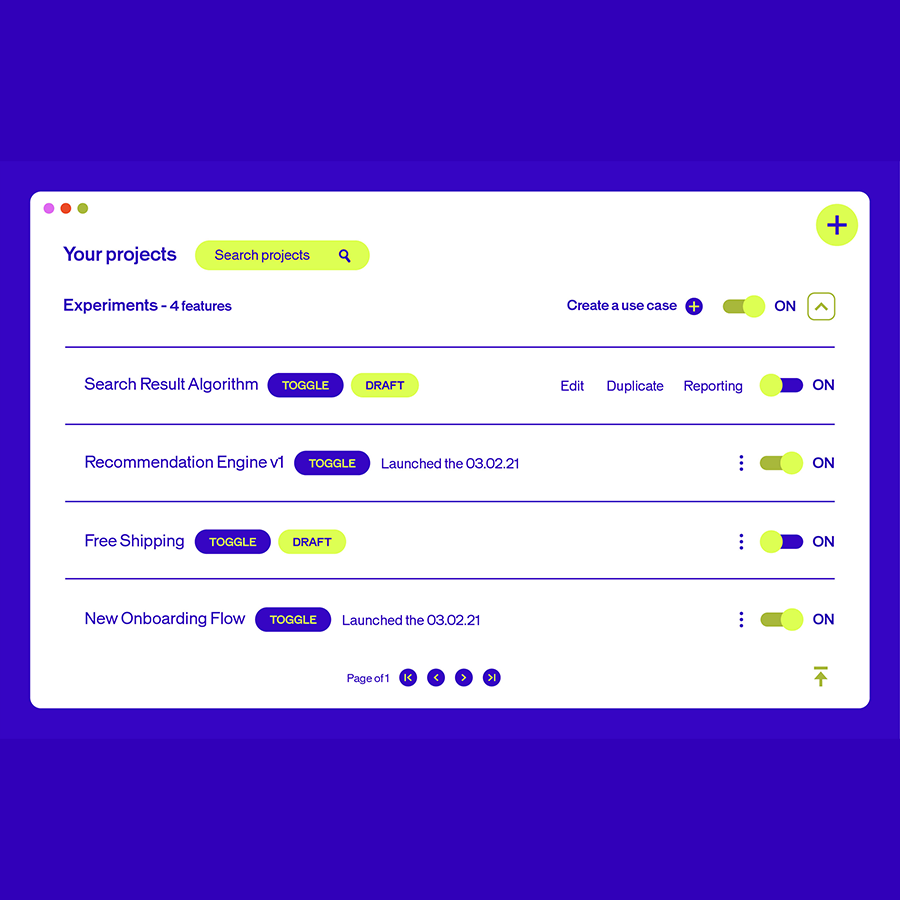

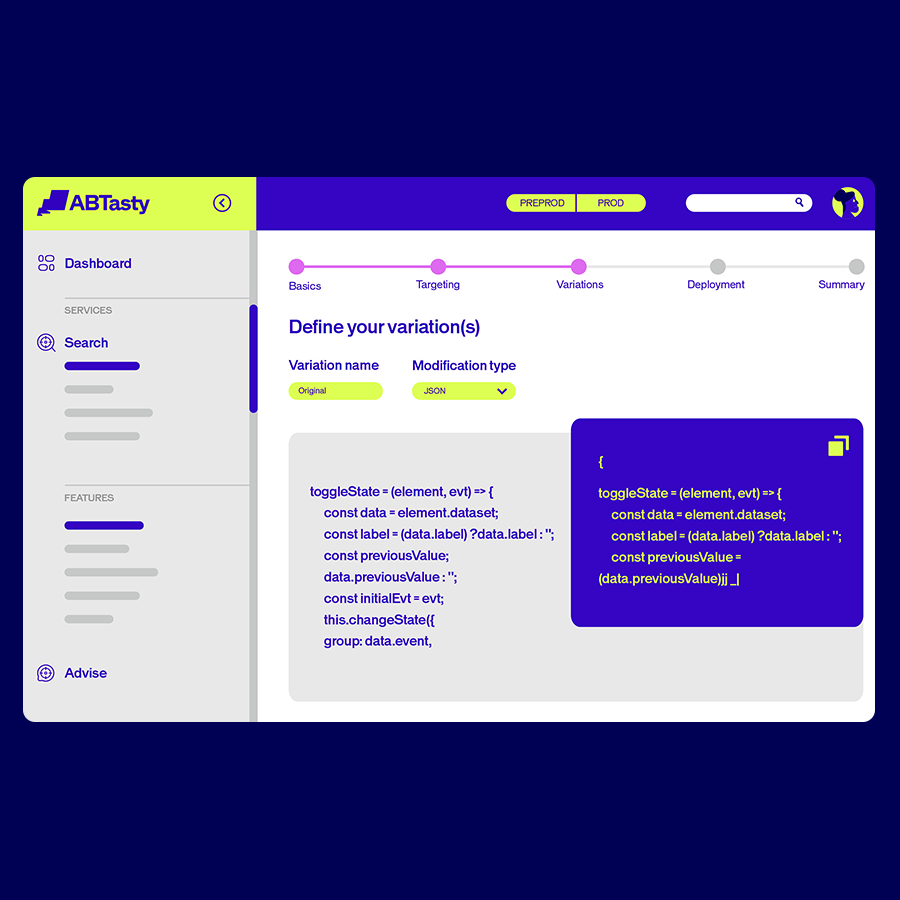

Experimentación WEB

Combina test avanzados con una construcción de experiencias simple y alcanza tus objetivos de conversión con rapidez y confianza.

- Empieza con algo sencillo o ve más allá con múltiples formas de experimentar a lo largo de todo el recorrido.

- Toma decisiones con la tranquilidad de que tus conversiones están en buenas manos.

Optimizar es nuestro objetivo. La colaboración es la forma de conseguirlo.

Nos tomamos tu progreso en serio, como si fuera propio. Desde el primer contacto hasta cada hito que alcanzamos juntos, estamos a tu lado.

Piensa en nosotros como una extensión de tu equipo: con mirada estratégica, enfoque en la experiencia del cliente y un plan concreto para lograr una optimización que realmente mueva la aguja.

Cuando se trata de optimizar, primero hay que probar. Luego viene lo mejor.

ROI

Maximiza el retorno de la inversión con una toma de decisiones basada en datos, para que tomes las decisiones correctas para tu negocio desde el principio.

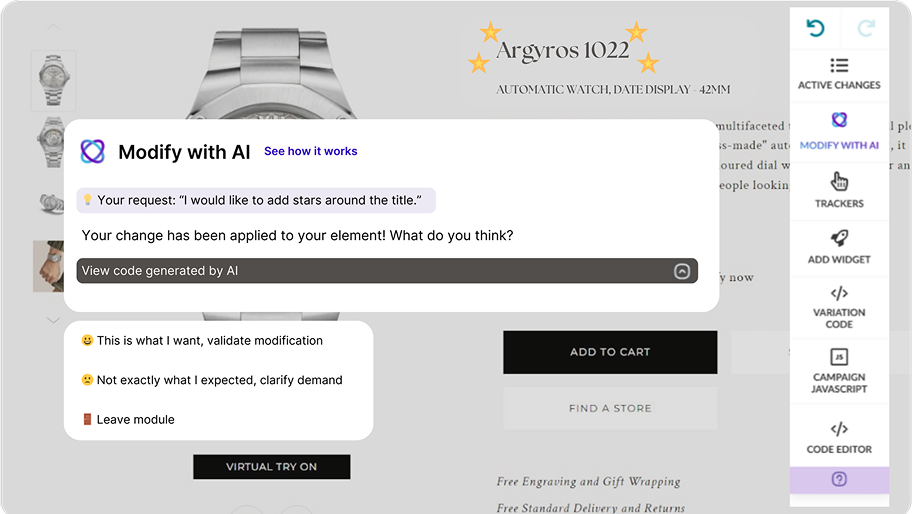

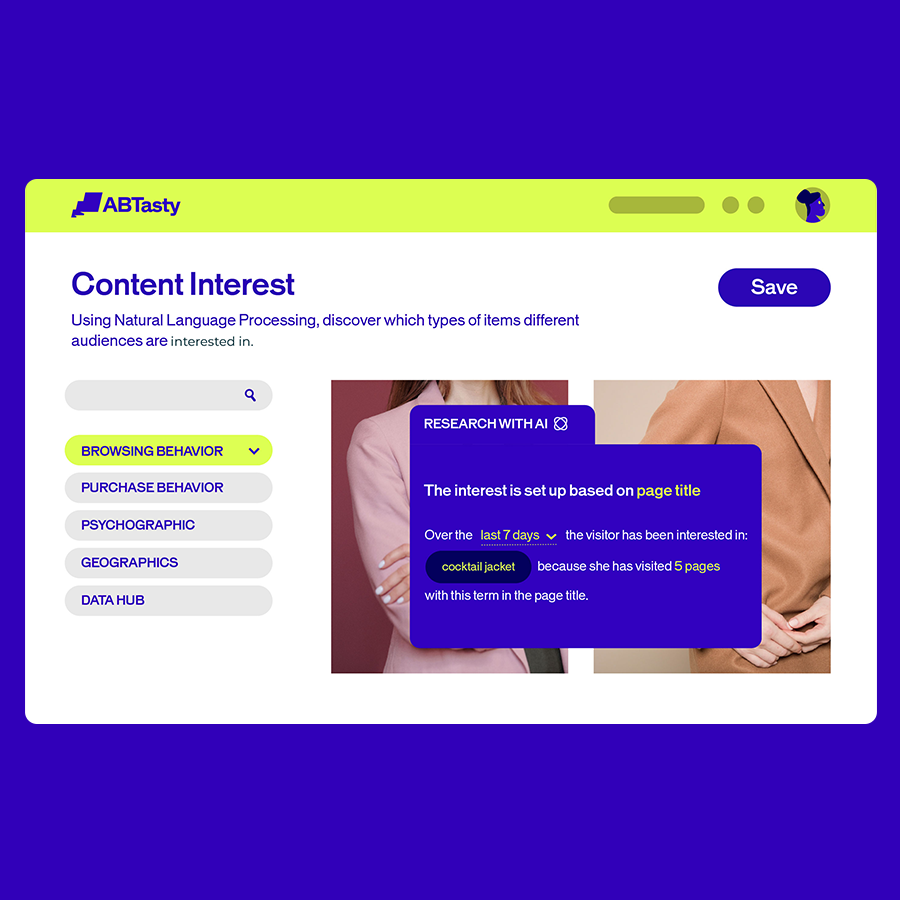

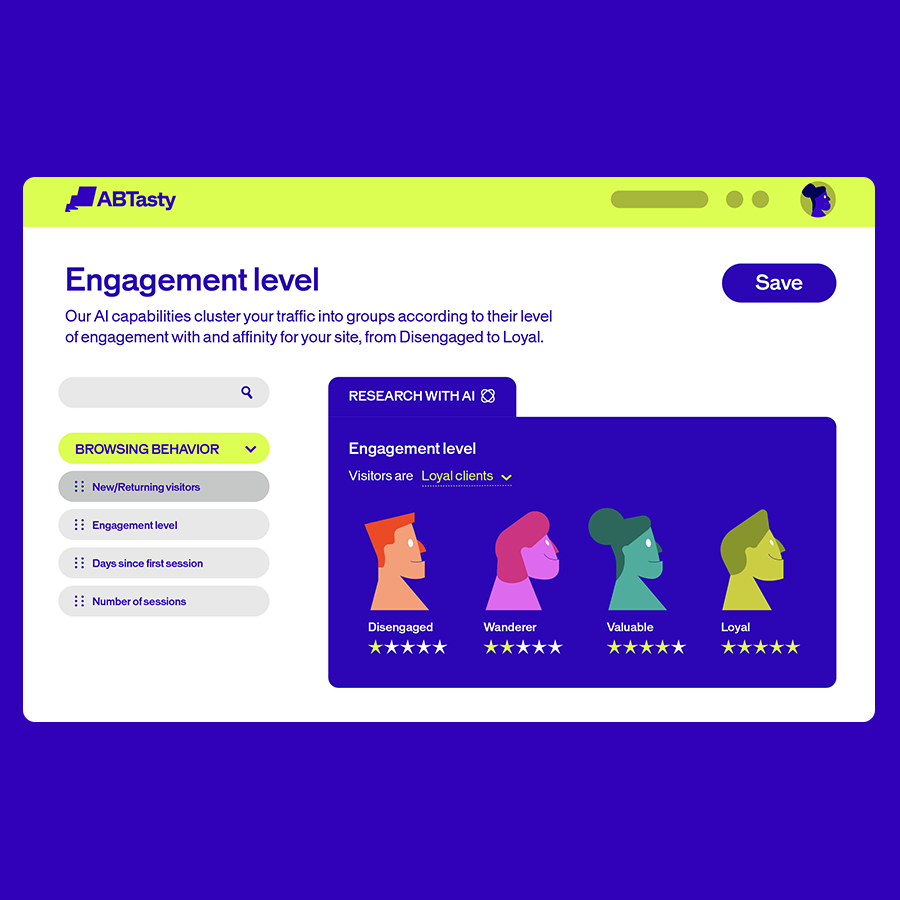

Compromiso

Impulsar el compromiso a lo largo de todo el recorrido del cliente con experiencias interactivas adaptadas a cada individuo.

Lealtad

Consigue que los clientes vuelvan una y otra vez con momentos personalizados en todos los puntos de contacto.

Riesgo

Atrévete sin miedo: prueba ideas, lanza de forma progresiva y activa funciones con total control.

¿Quiere ver AB Tasty en acción?

Crea experiencias integrales que impulsen el crecimiento en todos los canales digitales.

13 años transformando frustraciones en bases sólidas para el crecimiento.

Your paragraph text here

Cultura de prueba y aprendizaje

Llevamos nuestra cultura de testeo y aprendizaje a tu negocio.

Cada decisión deja de ser un riesgo y se convierte en una elección.

Nuestro equipo de expertos

Nuestro equipo ha trabajado con miles de clientes, en distintas etapas de su recorrido y en todo el mundo. Somos expertos en optimización de experiencias y te acompañamos en cada paso de tu roadmap hacia un impacto real.

Red de partners e integraciones

Hemos construido una red sólida de partners e integraciones para trabajar cómo y dónde lo necesites.

Plataforma robusta

Nuestra plataforma, con motores estadísticos pensados para el negocio, rendimiento optimizado y máxima seguridad, está lista para crecer contigo.

Casos de éxito

Crece más rápido con

AB Tasty

Obtén un recorrido personalizado de la plataforma